Yapay zeka modellerinin çalışma belleğini radikal biçimde küçültmeyi vaat eden yeni bir algoritma, teknoloji dünyasında büyük yankı uyandırdı. Google Research tarafından geliştirilen TurboQuant, büyük dil modellerinin inference sırasında kullandığı Key-Value (KV) Cache belleğini en az 6 kat küçültürken model doğruluğunda sıfır kayıp sağlıyor. Algoritma herhangi bir eğitim veya ince ayar gerektirmeden çalışıyor ve ihmal edilebilir düzeyde çalışma zamanı ek yükü getiriyor. Araştırma ekibinin başında Google Research Scientist Amir Zandieh ve Google VP & Fellow Vahab Mirrokni bulunuyor.

TurboQuant, PolarQuant ve QJL (Quantized Johnson-Lindenstrauss) adlı iki alt algoritmanın birleşiminden oluşan iki aşamalı bir sıkıştırma çerçevesi sunuyor. İlk aşamada PolarQuant, veri vektörlerini Kartezyen koordinatlardan kutupsal koordinatlara dönüştürerek geleneksel yöntemlerin zorunlu kıldığı pahalı normalizasyon adımını ve kuantalama sabiti ek yükünü tamamen ortadan kaldırıyor. İkinci aşamada ise QJL algoritması, sadece 1 bitlik bir bütçeyle birinci aşamadan kalan artık hatayı düzelterek sistematik bias'ı elimine ediyor. Bu iki aşamanın birleşimi, bilgi-teorik alt sınırlara yakın bir sıkıştırma kalitesi sağlıyor.

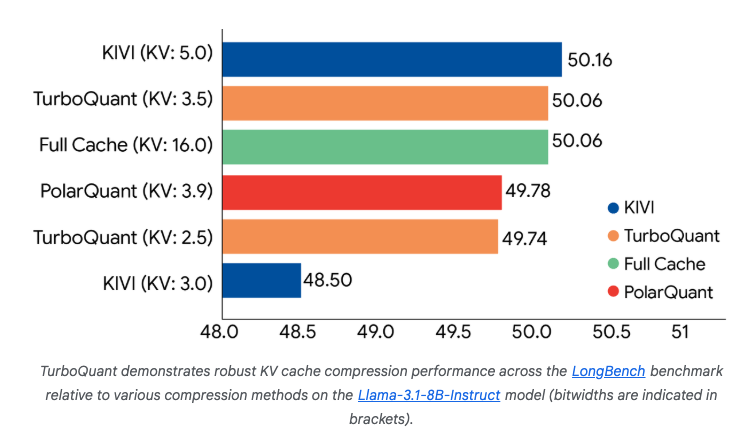

Deneysel sonuçlar dikkat çekici düzeyde güçlü. Gemma ve Mistral gibi açık kaynaklı modeller üzerinde LongBench, Needle In A Haystack, ZeroSCROLLS, RULER ve L-Eval gibi beş farklı benchmark'ta test edilen TurboQuant, tüm görevlerde mevcut yöntemleri eşledi veya geçti. NVIDIA H100 GPU'larda 4-bit TurboQuant, 32-bit kuantize edilmemiş anahtarlara kıyasla attention logit hesaplamasında 8 kata kadar performans artışı gösterdi. Vektör arama tarafında ise GloVe veri setinde büyük codebook'lar ve veri setine özel ayarlamalar kullanan rakip yöntemlere karşı en yüksek recall oranını elde etti.

Açıklamanın ardından teknoloji ekosisteminde hızlı bir hareketlenme yaşandı. Topluluk üyeleri 24 saat içinde algoritmayı Apple Silicon için MLX ve llama.cpp gibi popüler yerel AI kütüphanelerine taşımaya başladı. Öte yandan analistler, Micron ve Western Digital gibi bellek tedarikçilerinin hisse fiyatlarında düşüş eğilimi gözlemledi. ICLR 2026 konferansında sunulacak olan TurboQuant, yapay zekanın bir sonraki verimlilik çağının kaba güçle değil matematiksel zarafetle tanımlanacağının güçlü bir sinyali olarak değerlendiriliyor.