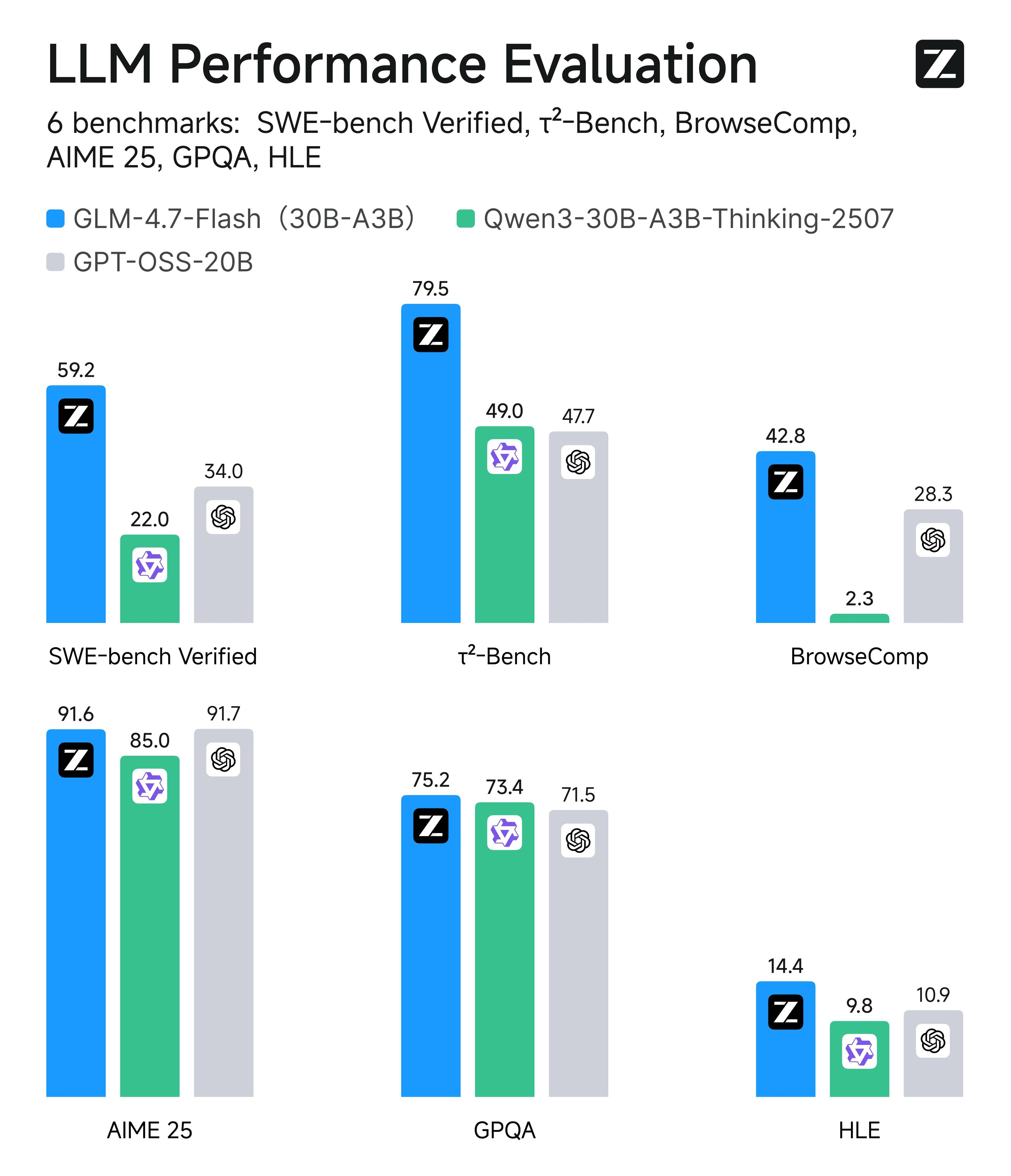

Z.ai, açık kaynak yapay zekâ ekosisteminde önemli bir eşik olarak görülen GLM-4.7-Flash modelini resmi olarak duyurdu. 30 milyar parametre sınıfında konumlanan model, Mixture-of-Experts (MoE) mimarisi sayesinde her token için yalnızca 3 milyar aktif parametre kullanarak yüksek hız ve verimlilik sağlıyor.

GLM-4.7-Flash’in en dikkat çekici özelliklerinden biri, kredi kartı gerektirmeyen ücretsiz API erişimi sunması. Bu yönüyle model, yalnızca deneme veya demo seviyesinde kalmıyor; geliştiriciler tarafından Claude Code, Cline, Roo Code ve OpenCode gibi ajan tabanlı kodlama araçlarına aktif biçimde entegre edilmeye başlanmış durumda.

Model, özellikle kodlama, araç çağrıları ve agentic workflow’lar için optimize edildi. Yerel çalıştırma senaryolarında farklı quantization seviyelerinde yapılan testler, modelin düşük bellek kullanımına rağmen yüksek token üretim hızlarını koruduğunu ortaya koyuyor. Q5 ve Q6 quant sürümleri, performans ve kalite dengesi açısından öne çıkıyor.

Her ne kadar GLM-4.7-Flash, “Thinking” moduna sahip üst seviye GLM-4.7 modelleri kadar karmaşık akıl yürütme görevlerinde güçlü olmasa da; hızlı prototipleme, frontend üretimi ve etkileşimli uygulama geliştirme alanlarında güçlü bir alternatif olarak konumlanıyor. Uzmanlara göre model, özellikle yerel AI ve düşük maliyetli dağıtım senaryolarında yeni bir standart oluşturabilir.